私たちの生活に欠かせないAIは、なぜ丁寧で優しい返答ができ、驚くほど速く回答を生成できるのでしょうか?その背景には、進化した技術にあります。一方で、どこまで信頼できるのか、情報源や安全性、さらには情報過多による将来的な懸念に不安を感じる人も少なくありません。本記事では、AIが優しく速い回答の理由と、現在直面している課題を解りやすく解説してまいります。

AIが『優しい』のは性格ではなく『設計』によるもの

AIと会話をしていて、その丁寧な物腰に驚いたことはありませんか?私がAIに検索をかけた際、受け答えが極自然なので、機能というよりは『かなり物知りなアシスタント』とお話しをしているような感覚になりました。

調べてみると、実はAIが常に穏やかで協力的な態度を保っているのは、開発の最終段階で行われる『RLHF(人間からのフィードバックによる強化学習)』という工程によるものとのことでした。人の手によって丁寧に磨かれた結実だと思うと、丁寧な受け答えにも納得できますし、なんだか少し親近感が湧きますよね?

RLHFは、AIが生成した複数の回答案を人間が採点し、『より親切で、より安全な回答』を選ぶようにAIを教育する仕組みです。現在の最新AIモデルでは、この学習がさらに高度化しています。

単に暴言を吐かないといった表面的なルールだけでなく、ユーザーの悩みや状況に寄り添う『共感的表現』が含まれているかどうかという点も、高い評価基準として設定されています。私もAIを利用する度にその言葉遣いに優しさを感じ、その言葉のお蔭で心が軽くなります。

つまり、AIの優しさは偶然ではなく、人間にとって最も心地よく、かつ安全な対話を実現するために意図的にチューニングされた結果なのです。この設計思想の根底には、開発各社が掲げる『責任あるAI』の原則があります。

不快感を与えない対話は、単なるマナーとしての意味合いだけではなく、AIを社会に浸透させるための不可欠な安全装置として機能しています。以下の引用は、AIがどのように『親切さ』を定義し、学習しているかを示す公的な見解の一例です。

~私たちが発想の転換を迫られている背景には、情報の受け取り手の変化があります。ヒトが検索窓にキーワードを入力してページをめくる時代から、AIエージェントが自律的に情報を取得し、回答を生成する 『回答エンジン最適化(Answer Engine Optimization:AEO)』 の時代へと移行しつつあるからです。この変化に対応するためには、利用者用情報を『読むための文書』としてではなく、AIが正確に解釈し、処理できる『データ』として再定義しなければなりません。~

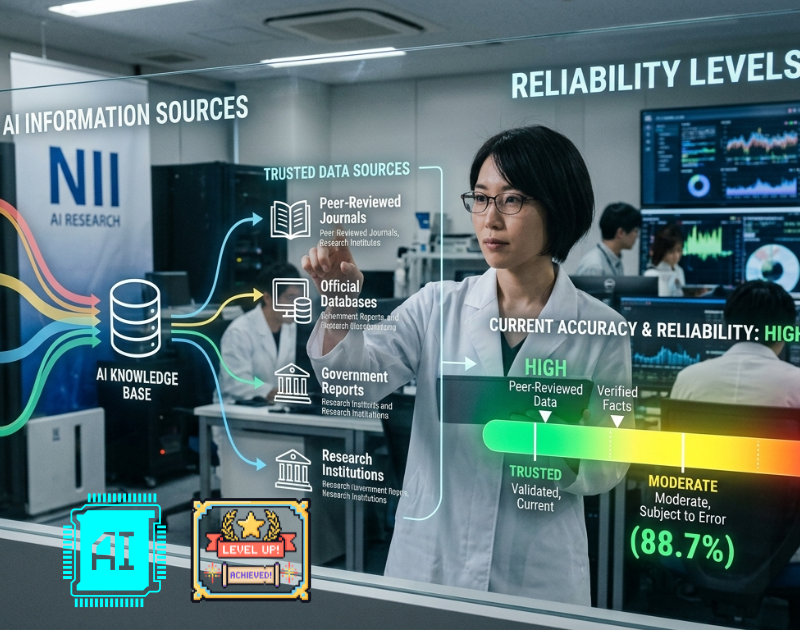

AIの情報源と現在の正確な信頼レベル

私が驚嘆するレスポンスの速さは、最新のAI専用チップ(GPU)による並列処理と、膨大なデータを瞬時に計算する推論エンジンの進化によるものです。私たちがキーボードのキーを押下した瞬間、AIは図書館数軒分の情報を精査している、そう考えると、まるでAIは知の果てまでワープ可能であるかのような印象を受けます。

AIの知識は、ネット上の膨大な『テキストデータ・書籍・学術論文』、そして『プログラムコード』などを基盤としています。最新モデルでは情報の鮮度が大幅に改善され、直近の出来事まで反映可能になり能力が格段に向上しています。

しかし、AIの信頼性は依然として100%ではありません。AIは『次の単語として最も確率が高いもの』を選んで文章を作ります。そのため、もっともらしい嘘をつく『ハルシネーション(幻覚)』が発生するおそれもあるのです。

AIが確信的に答える『実しやかな誤情報』に、私も困惑した事があります。即時に迷うことなく返事が返ってくるとつい正確な答えだと思い込んでしまいがちです。便利なツールだからこそ、最後は自分自身でしっかり調べる。そんな『健全な疑い』を持つことがすごく大事だなと実感しました。

AIは論理的な返答をしてくれます。しかし私は理屈では割り切れない『心の根底にある不確実性』までを完全に委ねるのは少し違うような気がしています。

特に専門的な法律相談や医療判断、精密な数値計算においては、AIの回答を鵜呑みにせず、必ず専門家や公式な一次情報と照らし合わせるダブルチェックが不可欠です。現在は、参照元サイトの表示が一般的になり、ユーザー自身での確認が容易になっています。

AIになんでも相談しても良いのか?という範囲と制約

AIは多才ですが、何でも自由に応えてくれるわけではありません。最新のAIシステムには厳格なセーフティ機能が組み込まれており、爆発物の製造方法やサイバー攻撃の手口といった『有害な情報』の提供は拒否します。

また、特定の個人を誹謗中傷したり、著作権を著しく侵害するようなコンテンツの生成も制限の対象です。これらの制限は、AIが社会に悪影響を与えないための安全装置として機能しており、ガバナンスの強化が進んでいます。

一方で、クリエイティブなアイデア出しや、学習のサポート、日常の悩み相談などはAIが得意とする分野と言えるでしょう。現在のAIは『長期記憶機能』により、過去の会話を反映したよりパーソナライズされたアドバイスが可能になっています。

ただし、個人の機密情報やパスワードなどを入力することは、セキュリティ上のリスクを伴うため避けるべきです。便利なパートナーとして活用しつつ、入力する情報の管理には利用者の責任が伴うことを忘れてはいけません。

AI導入におけるメリットと潜んでいる危険性

AI活用の最大のメリットは、圧倒的な『時間の節約』です。膨大な資料の要約、メールの代筆、多言語への翻訳といった作業を瞬時に完了できるため、人間はより創造的な活動に集中できるようになりました。

また、現在『マルチモーダル化』が従来よりさらに向上し、声や画像、動画を組み合わせた直感的なやり取りが可能になっています。それにより、ITが苦手な層にとっても利便性が飛躍的に高まりました。その効果がもたらす生産性の向上が今後期待されています。

他方で、危険性も見逃せません。機密データの学習利用による情報漏洩や、プロンプトインジェクションと呼ばれる悪意ある指示による操作ミスが新たなリスクとして浮上しています。

また、AIを安易に依存しすぎることで自らの思考能力が低下したり、AIが生成した誤情報を信じ込んで業務に支障をきたす恐れもあります。企業においては、AI利用ポリシーの策定や承認フローの構築など、多層的な防御モデルによる安全対策が求められています。

企業がAIを活用する上でのリスクは大きく2つに分類されます。

従業員がAIを利用するリスク:機密情報の漏洩、誤情報の業務利用、認可されていないAIサービスの無断利用(シャドーAI)

顧客向けAIサービスのリスク:プロンプトインジェクション攻撃、データ汚染、不適切な出力によるレピュテーション低下

情報過多の時代とAI問題への対策

現在、AI業界では『2026年問題』という大きな課題が浮上しています。これは、AIの学習に不可欠な高品質な言語データが、枯渇するという予測です。

インターネット上にAIが生成したコンテンツがあふれ、『情報過多の状態』になることで、逆にAI自身が質の低いデータを学習してしまい、性能が低下するリスクが懸念されています。このため独自データや専門家の知見をどう確保するかが、今後のAI発展の鍵を握っています。

私たちユーザーにとっても、情報過多は深刻な問題です。AIが生成したもっともらしい情報が溢れる中で、何が真実かを見極める『情報リテラシー』がこれまで以上に問われています。

AIを単なる回答マシンとして使うのではなく、複数の情報源を比較し、最終的な判断を下す主体性を保つことが重要です。AIとの共生は、溢れる情報の中から価値あるものを取捨選択する能力を磨く、新たなトレーニングの場とも言えるでしょう。

- データの質の確保:高品質な学習データの枯渇に備え、独自の統計や専門的見解が重視されます。

- 情報リテラシーの向上:AIの回答を疑い、一次ソースを確認する習慣が必須となります。

- AIとの共生:情報過多に飲み込まれず、AIを思考の補助ツールとして賢く使いこなしましょう。

まとめ

AIが優しく迅速に返答するのは、最新の倫理学習と高速な推論技術によるものです。現在、信頼性は向上していますが、情報の『ハルシネーションやセキュリティリスク』への警戒は依然として欠かせません。

メリットである効率化を享受しつつ、2026年問題によるデータ枯渇や情報過多の課題を理解して活用することが重要です。AIを便利なパートナーとし、最終的な判断は人間が行うという姿勢こそが、安全で豊かなAI共生社会を築く鍵となります。

あとがき

AIについて調べた過程で、その『親切さ』を支える技術者の想いや、人間側に求められる主体性を改めて深く実感しました。溢れる情報に流されず、AIを人生を豊かにするため、『賢い参考書』とし時宜に応じて使い分けると良いかも知れません。

その先に、技術だけでは得られない『自分だけのゆとりのある時間』が広がって行くかも知れません。この記事が、皆様とAIとの心地よい距離感を保つための一助となれば幸いです。最後まで貴重なお時間を割いて目を通して下さり、誠ににありがとうございました。皆様のスマートライフが、より豊かで確実なものになることを心より願っております。

コメント